對比學習作為一種自監督學習范式,近年來在計算機視覺和自然語言處理領域取得了突破性進展,并深刻影響了相關工程與技術研究的發展方向。其核心思想是通過構建正負樣本對,學習數據表示,使相似樣本在表示空間中靠近,而不相似樣本則彼此遠離。

一、 計算機視覺領域的演進與突破

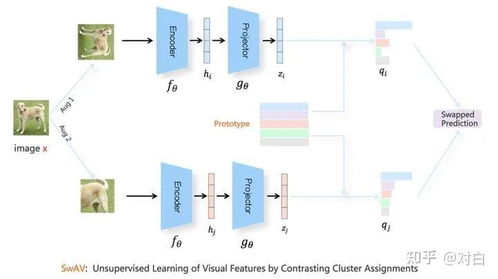

在CV領域,對比學習的興起極大地緩解了對大規模標注數據的依賴。早期工作如InstDisc、CPC等初步驗證了對比學習的可行性。里程碑式的進展出現在2020年,MoCo系列和SimCLR通過構建大規模負樣本隊列與更強的數據增強策略,在ImageNet分類等任務上達到了接近有監督學習的性能。隨后的BYOL和SimSiam等研究進一步創新,摒棄了顯式的負樣本,通過非對稱網絡結構和停止梯度等技術實現了卓越性能,簡化了訓練流程。這些方法在目標檢測、語義分割等下游任務的遷移性能上表現出色,推動了自監督視覺預訓練模型的廣泛應用。

二、 自然語言處理領域的適配與創新

在NLP領域,對比學習最初被用于改善句子表示學習,如SimCSE通過簡單的“Dropout”作為數據增強方式構建正樣本對,顯著提升了語義文本相似度任務的性能。隨著預訓練語言模型的發展,對比學習被集成到BERT、GPT等模型的訓練中,以獲取更高質量、更均勻分布的上下文表示,緩解各向異性問題。例如,通過對比損失微調預訓練模型,或在預訓練階段加入對比目標(如InfoNCE損失),增強了模型對語義相似性和細微差異的判別能力。這直接提升了文本分類、語義檢索、對話系統等應用的性能。

三、 跨模態融合與統一架構

一個顯著的趨勢是CV與NLP在對比學習框架下的融合。CLIP模型是典范之作,它通過海量的圖像-文本對進行對比學習,實現了開放世界的視覺概念理解,其“提示詞工程”范式革新了零樣本圖像分類。ALIGN、Florence等后續工作進一步擴展了規模和能力。這種跨模態對比學習催生了多模態大模型的研究熱潮,為圖像生成、跨模態檢索等任務提供了強大基礎。

四、 工程與技術研究發展

在工程化與試驗發展層面,對比學習的研究重點正朝著效率、可擴展性和理論理解深化:

- 效率優化:研究如何減少對大批量和海量負樣本的依賴,如通過內存庫、動量編碼器,或探索更高效的正樣本構建策略。

- 理論探索:深入分析對比學習成功的內在機理,如均勻性-容忍性的權衡、特征坍縮的避免機制,以及它與互信息最大化的理論聯系。

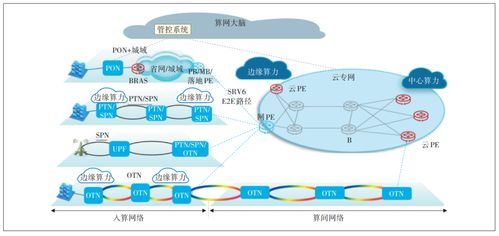

- 規模化與部署:研究如何將對比學習框架高效地部署到超大規模數據集和模型上,并探索其在聯邦學習、邊緣計算等場景下的應用。

- 領域特定適配:在醫療影像、遙感、工業質檢等特定領域,結合領域知識設計專用的數據增強和正負樣本對構建策略,以解決標注數據稀缺問題。

結論

對比學習已成為CV和NLP領域構建基礎模型的支柱技術之一。它不僅推動了學術前沿的突破,更通過提供強大的預訓練表示,降低了諸多下游AI任務對標注數據的門檻,加速了人工智能技術的產業化落地。隨著對學習動力學更深刻的理論理解,以及與大語言模型、擴散模型等技術的進一步結合,對比學習有望在實現更通用、更高效的人工智能系統中持續發揮關鍵作用。